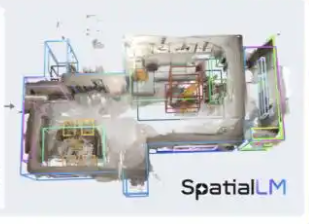

SpatialLM 是群核科技开源的空间理解多模态模型,该模型仅通过一段视频即可生成物理正确的3D场景布局,赋予机器人和智能系统类似人类的空间认知能力。SpatialLM突破了传统大语言模型对物理世界几何与空间关系的理解局限,通过分析普通手机拍摄的视频,能重建出详细的 3D 场景布局,标注出房间结构、家具摆放、通道宽度等信息。模型基于大语言模型框架,结合点云重建和结构化表示技术,将视频中的场景转化为结构化的 3D 模型,为具身智能训练提供了高效的基础框架。

SpatialLM的主要功能

- 视频生成 3D 场景:SpatialLM 可以将普通手机拍摄的视频转化为详细的 3D 场景布局。通过分析视频中的每一帧画面,重建出场景的三维结构,包括房间布局、家具摆放、通道宽度等信息。

- 空间认知与推理:模型突破了传统大语言模型对物理世界几何与空间关系的理解局限,赋予机器类似人类的空间认知和解析能力。能对场景中的物体进行语义理解,生成结构化的 3D 场景布局,标注出物体的三维坐标、尺寸参数和类别信息。

- 低成本数据采集:SpatialLM 不需要借助复杂的传感器或智能穿戴设备,普通手机或相机拍摄的视频即可作为数据输入。大大降低了开发者的数据采集门槛,使更多企业和研究者能够快速开展相关研究。

- 具身智能训练:SpatialLM 为具身智能领域提供了基础的空间理解训练框架。企业可以针对特定场景对模型进行微调,实现机器人在复杂环境中的导航、避障和任务执行能力。结合群核科技的空间智能训练平台 SpatialVerse,机器人可以在仿真环境中完成技能学习,形成从认知到行动的完整闭环。

- 虚拟场景生成:SpatialLM 可以将现实世界的数据转化为虚拟环境中的丰富场景。通过其合成数据引擎,可以泛化生成亿万级新场景,为虚拟现实、增强现实和游戏开发等领域提供强大的支持。

SpatialLM的技术原理

- 视频输入与点云重建:SpatialLM 使用 MASt3R-SLAM 技术处理输入的 RGB 视频。将视频拆解为帧,提取物体的细节空间点,计算其深度和位置,生成高密度的 3D 点云模型。

- 点云编码与特征提取:点云数据被编码器转化为紧凑的特征向量。保留了场景中物体的关键几何和语义信息。

- 大语言模型生成场景代码:通过大语言模型(LLM),将点云特征转化为结构化的场景代码。包含空间结构的坐标和尺寸,标注了物体的语义边界框(如“沙发 – 长 1.8 米 – 距墙 0.5 米”)。

- 结构化 3D 布局生成:场景代码被进一步转换为结构化的 3D 场景布局,明确标注出每个物体的三维坐标、尺寸参数和类别信息。可以被可视化工具还原为可交互的 3D 场景。

- 物理规则嵌入:SpatialLM 内置了物理常识(如“家具不能悬空”“通道宽度≥0.8 米”),确保生成的 3D 场景符合物理规则。

SpatialLM的项目地址

- Github仓库:https://github.com/manycore-research/SpatialLM

- HuggingFace模型库:https://huggingface.co/manycore-research/SpatialLM-Llama-1B

SpatialLM的应用场景

- 具身智能训练:SpatialLM 能帮助机器人在虚拟环境中进行障碍规避、物体抓取等任务的训练。

- 自动导航:在机器人导航任务中,SpatialLM 可以实时解析环境中的空间信息,帮助机器人避开障碍物并规划最优路径。

- AR/VR 领域:SpatialLM 能将现实世界的场景快速转化为虚拟环境中的丰富场景,支持增强现实和虚拟现实应用的开发。

- 建筑设计与规划:SpatialLM 可以分析建筑物的 3D 点云数据,识别出墙体、门窗等结构信息,帮助建筑设计和规划人员更高效地进行设计工作。

- 教育与培训:教育工作者可以用 SpatialLM 开发教育软件,帮助学生学习 3D 建模和空间视觉能力。通过直观的 3D 场景生成和解析,学生能更好地理解空间关系和几何概念。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...