轻量化模型能够实现本地部署,进一步基于团队的自研量化技术,目前 MetaStone-L1-7B 已支持在手机本地部署。而相对来说,轻量化模型也更能显著降低推理成本,基于团队的自研高效推理技术,每百万 token 推理成本可以低至 0.2 元。

尽管大多数轻量级开源推理模型,会更专注于数学能力的提升,但问小白想仍然希望能再多迈一步,实现代码能力和数学能力的双剑合璧。

MetaStone-L1-7B是什么

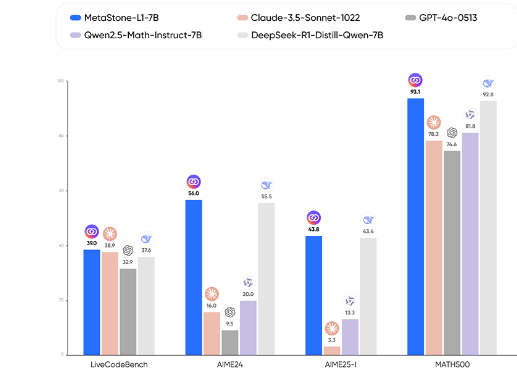

MetaStone-L1-7B 是 MetaStone 系列中的轻量级推理模型,专为提升复杂下游任务的性能而设计。在数学和代码等核心推理基准测试中达到了并行模型的顶尖水平(SOTA),与 Claude-3.5-Sonnet-1022 和 GPT4o-0513 等 API 模型的性能相当。模型基于 DeepSeek-R1-Distill-Qwen-7B 由 GRPO 训练而成。

MetaStone-L1-7B的主要功能

- 强大的推理能力:在数学和代码等核心推理基准测试中,达到并行模型的顶尖水平(SOTA),与 Claude-3.5-Sonnet-1022 和 GPT4o-0513 等 API 模型的性能相当。

- 优化的训练基础:基于 DeepSeek-R1-Distill-Qwen-7B 由 GRPO 训练而成,具备良好的性能基础。

- 灵活的使用设置:建议使用温度为 0.6、顶部采样概率为 0.95,最大生成长度为 32k,获得最佳性能。

- 针对特定问题的优化提示:对于数学问题,提示中添加“Please reason step by step, and put your final answer within \\boxed{}.”;对于代码问题,提示中添加特定格式要求,可进一步提升模型的推理效果。

MetaStone-L1-7B的技术原理

- 基于 DeepSeek-R1 的技术架构:MetaStone-L1-7B 是基于 DeepSeek-R1-Distill-Qwen-7B 通过 GRPO 训练而成。DeepSeek-R1 本身采用了先进的视觉强化微调(Visual Fine-Tuning, V-FT)技术,通过跨模态对比学习、梯度解耦训练和注意力门控机制等创新方法,显著提升了模型的视觉理解和多模态对齐能力。

- 跨架构计算集群的支持:元石智算提出了 RISC-V & x86 跨架构计算集群方案,通过“一云多芯”的设计兼容多种 CPU 芯片架构,包括 RISC-V 和 x86。使 MetaStone-L1-7B 能在不同架构的计算资源上高效运行,充分发挥不同体系架构 CPU 的性能优势。

- 云原生技术的应用:元石智算创新性地提出了基于云原生技术路线的“MetaStone CloudOS”,为应用提供从容器、虚拟化、存储、网络、安全等全部云基础设施能力。MetaStone CloudOS 突破了 RISC-V 架构集群与 x86/ARM 架构集群在资源调度上的壁垒,实现了真正的跨架构算力流动。

- 低参数量高效率的设计:MetaStone-L1-7B 仅需 7B 参数量可达到传统多模态模型(如 Flamingo-80B)的图文理解能力。这种低参数量的设计降低了计算资源的需求,通过混合精度训练和梯度检查点等技术进一步提升了训练效率。

MetaStone-L1-7B的项目地址

- HuggingFace模型库:https://huggingface.co/MetaStoneTec/MetaStone-L1-7B

MetaStone-L1-7B的应用场景

- 数学问题解答:能逐步推理并解决复杂的数学问题,例如完成平方、解方程等。用户只需输入问题,模型会按照要求逐步推理并给出最终答案,答案会以特定格式(如\boxed{})呈现,方便学生理解和学习。

- 编程辅助:对于编程问题,模型可以生成符合要求的代码,按照指定格式输出。例如,用户可以要求模型读取输入、解决问题并将答案写入输出,模型会生成相应的代码片段。

- 智能客服:能快速准确地回答用户的问题,提供解决方案和建议,提升客户服务的效率和质量。

- 内容创作:帮助用户生成文本内容,如文章、故事、诗歌等,激发创作灵感。

- 代码生成与优化:根据用户的需求生成相应的代码片段,帮助开发者快速实现功能,提高开发效率。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...