“真正推动进步的,不是已知领域的重复建设,而是对未知疆域的勇敢探索。

《Manus没有秘密》由明浩老师撰写的解读 AI Agent 的70页PPT,主要介绍了 AI Agent(智能体)技术从L1到L3的过程,探讨了 AI Agent 的定义、实现原理、使用体验以及未来的发展趋势。通过对Manus等Agent产品的分析,深入讨论了AI技术的现状、挑战和未来方向。

Agent的定义与核心叙事

Agent的定义与核心叙事

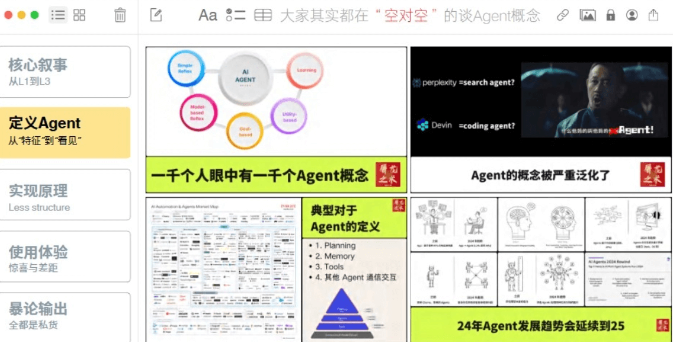

从Agent的定义出发,提出了从“特征”到“看见”的转变,强调Agent的核心在于其通用性和对复杂任务的处理能力。Agent被定义为能自主完成任务、进行推理和交互的智能体,目标是让用户通过简单的自然语言指令能实现复杂的功能。

![]()

从L1到L3的发展历程

- L1:基础模型阶段,主要关注简单任务的处理。

- L2:引入了更复杂的任务处理和工具的使用,如多步推理和多模态交互。

- L3:追求通用性和对任意任务的处理能力,强调Agent的自主性和对复杂任务的拆解与执行。

实现原理与技术实现

实现原理与技术实现

探讨了Agent实现的技术原理,包括预训练模型、强化学习、少样本学习等技术的应用。特别提到了“Less structure”(少结构化)的概念,强调让模型自主探索思考范式的重要性,不是依赖于过度的结构化方法。

使用体验与用户感知

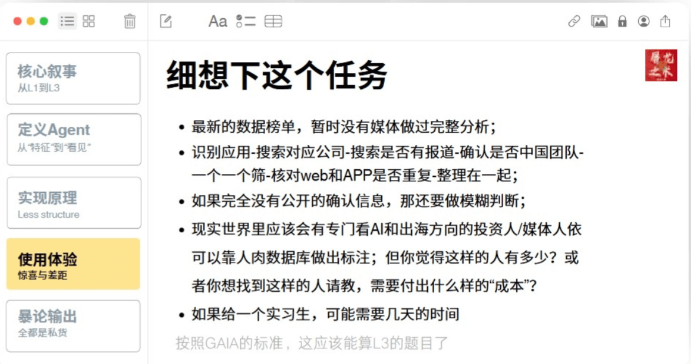

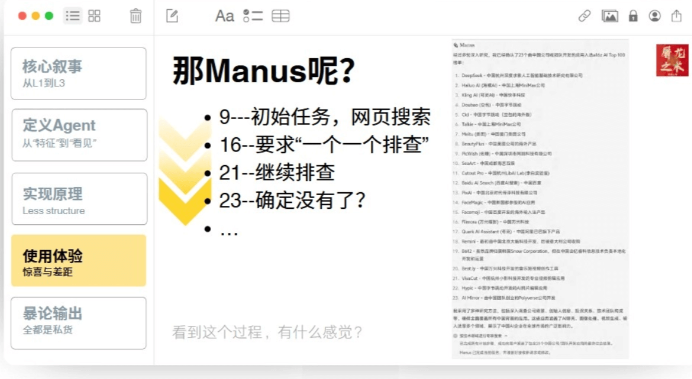

从用户的角度出发,讨论了使用Agent的体验和感知。通过具体的使用案例,展示了Agent在实际应用中的优势和不足。例如,Manus在处理复杂任务时表现出色,在某些情况下也可能出现性能下降或错误。

惊喜与差距

对比了Agent在实际应用中的表现与预期之间的差距,分析了当前Agent技术存在的问题和挑战。尽管Agent在复杂任务处理、多模态交互等方面取得了显著进展,但在某些任务中仍存在性能瓶颈。

Manus的诞生与创新

Manus的诞生与创新

重点介绍了Manus这一Agent产品的诞生背景、设计理念和技术创新。Manus通过其创新的交互方式和强大的任务处理能力,展示了Agent技术的潜力。Manus的设计理念是让用户通过简单的自然语言指令就能完成复杂的任务,不需要用户进行复杂的操作。

AI行业的发展与未来趋势

AI行业的发展与未来趋势

文章站在行业的高度,分析了AI行业在过去几年的发展历程,以及未来可能的发展趋势。讨论了大模型、Agent技术、多模态交互等技术对AI行业的影响,以及如何推动AI技术的进一步发展和应用。

关于Agent的思考与总结

对Agent的概念、技术实现、使用体验等方面进行了全面的总结和思考。提出了对Agent未来发展的期望和建议,包括如何提升Agent的通用性、性能和用户体验,以及如何在市场竞争中建立优势。

引言

大家好,我是明浩。我翻了一下自己小宇宙的后台,距离我上一次更新PPT的solo博客,应该刚过去半个多月的时间。上一期,我讲的是关于DeepSeek的内容,以及对2025年所有Agent的一些预期。但现在回头去看,会发现我对Agent的讲述在当时其实是有些空泛的。我相当于在那个时间点,针对那一章节的内容做了一些讨巧式的处理。所以,那一段内容回头来看,其实并没有太多的观点,更像是已有信息的排列组合。

为什么会这样呢?其实说实话,在那个时间点,无论是我还是整个业界,对Agent这件事情都没有那么明确的认知。这也直接引出了今天的话题。在过去的一周左右时间里,整个AI行业都在谈论Manus。作为业界的观察者,我对这件事情也有了更深的认知和理解,所以有了今天这样一期播客的内容。

关于Manus的背景和意义

2025年已经过去了两个半月的时间,我做了三个超长的PPT。今天的内容叫“Manus没有秘密”。本来我还加了一个副标题,叫“2025年会是AI Agent年吗?”但在我制作PPT的过程中发现,其实这个问题可能不需要再问了。我们正式进入今天的内容,是没有秘密的。这个PPT大概有五章内容,如果大家需要,也可以去下载我的PPT文档。

五章内容的标题分别是:核心叙事定义、Agent实现原理、Manus的使用体验以及最后的一些暴力输出。我很庆幸的是,当你对一件事情有比较多的了解时,才会有比较多的包容。当你没有那么了解的时候,更多做的是信息的罗列。我们正式进入今天的内容。

从DeepSeek到Manus

差不多一个月多之前,我做的上一个PPT内容是“从DeepSeek爆火看2025年的AI行业发展”。这个PPT包括了DeepSeek爆火的整个过程,过去两年AI行业的叙事,以及新的蓄势可能性,还有最后一章关于Agent的内容。但其实这四章内容中的前三章我觉得都是老的东西。第四章本来应该有些观点和出彩的地方,但受限于我对这个行业的认知和理解,我会觉得当时做的关于DeepSeek以及AI Agent内容的第四章并不那么理想。

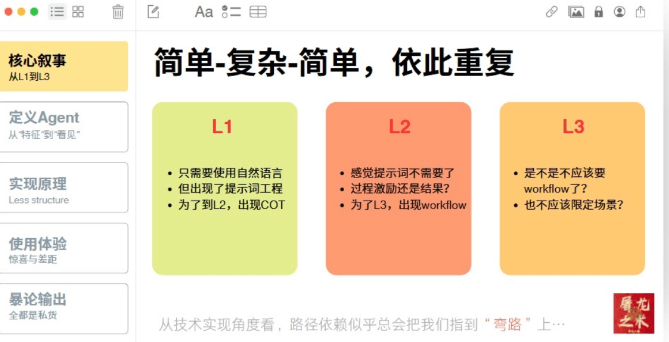

很幸运的是,我们聊到了今天的话题。同样地,我在上一期播客的PPT里就有讲过,如果那个大概70页的PPT只用一页做总结的话,就是OMI定义的L1到L5。我们现在处于L2到L3之间。详细来说,L1就是Chatbot,以ChatGPT为代表的。我们今天能够用到的很多产品都是L1。L2是推理模型,比如OpenAI的O1、DeepSeek 21以及之后一系列头部厂商发布的推理模型。L3就是我们今天讨论的最直接的话题——Agent。

在上一次的PPT里,我也讲过Agent的概念被无限泛化了。今天很好,有人把它定义得更清楚了。所以如果今天还只用一页PPT来总结所有内容,我依然可以用这些PPT来总结。

从L1到L3的详细解读

我们来详细聊聊L1到L3。其实之前在整理PPT的过程中,我并没有那么详细地解释,只是列了一些问题。比如,我们从LE的Chatbot再往前推,在2014、2015年兴起的那一波AI 1.0年代的模型公司,其实今天也还在,比如中国的AS小龙。那么,回头去想那个年代的AI 1.0和大模型年代的AI最大的区别是什么?我们当时是怎么从原来那个样子走到大模型的,走到GPT的?然后再去想2022年底的时候,其实2022年中GPT就发布了3,然后发布了3.5。到2022年11月30号,ChatGPT发布,才被定义成这个行业到了一个节点。

我想问的是,ChatGPT对于GPT 3.5的意义是什么?这是L1。那从L1到L2的时候,从OpenAI的O1在2023年9月份发布,到DeepSeek 21在2025年发布,我们又是怎么走到L2的?还有一点就是,为什么每一次的大模型的重大更新,都看上去有一波应用公司死掉?这个问题再延展,变成了模型和产品这两件事情到底是统一的还是分开的?有可能会说模型即产品,也有可能会说模型和产品应该分开。那是不是这件事情在不同的阶段有不同的答案呢?

我的核心思想其实很简单,就是刚才我问的我们从之前的1.0年代到了大模型年代,然后从基础大模型到推理模型,到今天我们去探讨Agent。

关键词:通用、技术实现、用户感知

第一个关键词我写的叫“通用”,也就是说我们这一步的大模型叫通用大模型。到了推理模型的时候,我们也开始在做叫通用推理模型。因为我们几乎没有做一个什么垂直行业的垂直模型,对吧?推理模型出来就是通用的。那这个东西再往下推,如果L3是Agent,那是不是也应该是一个通用Agent呢?

第二个关键词叫“技术实现”。刚才问我们怎么一步步走过来,从之前的AI 1.0到大模型,我们之前用过一个关键词叫“大力出奇迹”,对吧?到了L2的时候,强化学习变得重要了。在L3,或者说从AI 1.0到L1再到L2的过程中,你会发现一直大家遵循的一个观点是说,尽量少的控制,给更多的数据,更强化学习的方式,让模型本身自己学习,这是技术实现的过程。

第三个关键词叫“用户感知”。也就是说对于一个用户而言,他怎么去感知技术的变化。大家经常会说所谓的“啊哈时刻”(Aha Moment),就是用户哇哦会像看到魔法一样,那种时刻。对于一个普通人而言,是不是那么难理解的一件事情。然后你会发现从L1到L2到L3的过程中,都在经历从简单变复杂再变简单再变复杂的过程。所以如果总结来看L1到L3的整个过程,我会觉得有几个关键词:通用、技术实现、用户感知。听起来有点像神棍,对吧?我们一个个来看。

通用性的重要性

先看“通用”。我用了一张创新工场在2015年刚成立的时候,开复老师在一次发布会上的PPT的一页。他讲的是AI 2.0就是大模型克服了AI 1.0单领域和多模型的限制。比如在之前的1.0年代,我们是用单一的数据集,然后在单一的场景下训练固定的模型。到了大模型年代变成通用的,对吧?这个是在大模型年代就出现的。

技术实现的路径

然后我们是怎么到达L2的呢?如果大家有兴趣可以去详细回看我之前讲DeepSeek那期的博客。在O1发布之后,世界上的主流模型厂商都希望复现O1的推理模型。所以用了两个路径或两个技术方案,一个叫COT(思维链),大家会认为让大模型以一步一步的方式去思考问题,这个叫思维链。思维链出现之后就变成一个训练的过程当中,我们是针对这个链条的每一个环节做激励,还是针对结果做激励。所以当时有一种路线方案是针对每一个过程,就是PRI(过程奖励)。

但最后的结果告诉大家,无论是最早浮现出来的Kimi的O1还是DeepSeek的RE,我们去看他的开源文章以及一些他们的员工的社交媒体发布,最后证明是完全只依靠对结果的强化学习。我们走到L2的整个过程,就是不需要在过程中对模型本身做更多的限制,就跟当年阿尔法狗(AlphaGo)出现阿尔法零(AlphaZero)一样。就是不需要跟人类去学习棋谱,我们就可以得到一个更强的阿尔法围棋模型,它摆脱了人的经验。

DeepSeek也是一样。DeepSeek的基础模型叫V3,基于V3的模型能力做强化学习,仅仅针对模型本身的结果做奖励,就出现了RE Zero,就跟阿尔法零一样。这是我们走到L2的整个过程。然后从RE Zero再经过一点点的预训练、简单的基础信息的增加以及数据的调整,我们出现了今天我们在用的R1。并且R1的训练方案和方式同时出现在了Llama和Qwen上,也对那几个模型提升了效率。这是整个我们走到L2的过程。

用户感知的变化

那你会看这样一个过程来说,你会发现这是一个纯技术路线的模型层的实施。那在用户层是什么呢?我有一个说法叫“用户需要magic”,就跟Aha Moment一样。Moment是什么?就是用户作为一个非技术人员非常清晰地看见了,看见是非常重要的。

我们回头来看L1的年代,ChatGPT发布的时候,作为用户来讲他看见了什么?说得赤裸一点,他看见了机器在“吐字儿”,就这么简单,对吧?那L2的时代就是O1或者DeepSeek R1的时候,用户看见了什么?用户看见了模型在推理。同样这个逻辑往下推,L3如果是Agent,或者说那个Aha Moment出现在Agent这个板块里,那也应该是一个用户看见了什么东西,对吧?用户需要magic。

简单与复杂的变化

然后再说刚才我们提到的一个关键词叫“简单复杂”,这是一个重复的过程。我们看L1年代,ChatGPT刚发的时候,所有人都说我们只需要自然语言就可以跟大模型交互。但你发现需要出现非常复杂的提示词工程,对吧?你需要描述非常多,甚至有严格的格式去给模型做刺激,他才会给你好的答案。然后这是L1。为了到L2的时候,我们刚才讲了前面又出现了思维链,对吧?我希望让模型一步一步思考,然后R2真的实现的时候,你发现我们现在在用比如DeepSeek的RE各种各样的推理模型的时候,感觉那个提示词工程也不太需要了。模型自己可能会理解,但训练R的过程其实是一个大家去跑一些弯路的过程。

有很多公司很多厂商用的过程激烈的方式。然后现在我们要去L3了,要做Agent了。你会发现很多厂商在尝试用叫workflow(工作流)的方式来定义模型的执行。如果依然延续这个逻辑来讲,从简单到复杂再到简单再到复杂再到简单,那L3是不是应该也不需要workflow,而且也不应该限定场景。因为你会发现过去这几次的技术更迭,从技术实现的角度来看,我们的这种路径依赖往往会把我们引到一些弯路上,最后成功的都不是一些弯路。

总结L1到L3的过程

总结一下第一张掰开了揉碎的从L1到L3。第一个关键词叫“通用”,不是垂类,不限定具体场景,不设置边界。当然这会非常难,且初期的实现一定是不完美的。通用,第二,让大模型自己来,不要干预,不要加添加条件,更少的限制,更好的激励。当然对于在做相关工作的公司而言,比较考验他们的是成本跟结果之间的博弈。第三,要傻瓜化操作,尤其是对于用户,要让用户看见,看见哪怕是看见实现的过程也很重要,不能一次又一次地走入复杂的区域的用户,那还需要什么呢?

通过用AI梳理,我们可以快速了解这期播客内容,遇到感兴趣的,再抽时间完整地看一遍播客,既提高了学习效率,还能让你对这些知识的印象更加深刻。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

Agent的定义与核心叙事

Agent的定义与核心叙事 实现原理与技术实现

实现原理与技术实现 Manus的诞生与创新

Manus的诞生与创新 AI行业的发展与未来趋势

AI行业的发展与未来趋势